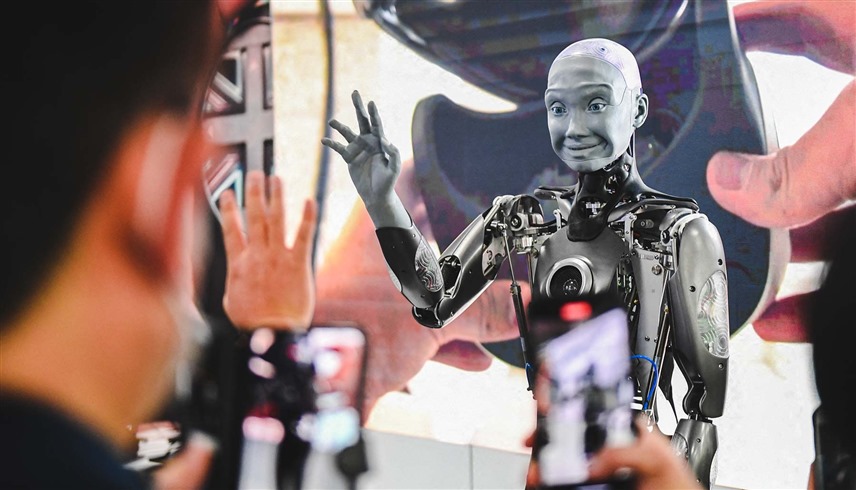

وافق وزراء الاتحاد الأوروبي بشكل نهائي، اليوم الثلاثاء، على "قانون الذكاء الاصطناعي"، الذي ينظم استخدام التكنولوجيا التحويلية في الحالات "الشديدة الخطورة"، مثل إنفاذ القانون والتوظيف.

ويأمل الاتحاد الأوروبي عبر وضع قواعد صارمة للذكاء الاصطناعي، في وقت مبكر نسبياً من تطوير هذه التكنولوجيا، في معالجة المخاطر المتعلقة به في الوقت المناسب وإلى المساعدة في وضع جدول الأعمال الدولي لتنظيمه.

ويتعين أن تستوفي الأنظمة المخصصة للاستخدام في الحالات "الشديدة الخطورة"، والمدرجة في ملاحق القانون، معايير مختلفة تشمل الشفافية والدقة والأمن السيبراني وجودة بيانات التدريب، ضمن أمور أخرى.

ومن المقرر أن يتم حظر كلي لبعض الاستخدامات، مثل تسجيل الائتمان الاجتماعي على الطريقة الصينية.

وسيتعين على الأنظمة ذات المخاطر المرتفعة الحصول على شهادة من الهيئات المعتمدة قبل طرحها في سوق الاتحاد الأوروبي.

وسيشرف "مكتب الذكاء الاصطناعي" الجديد على إنفاذ القانون على مستوى الاتحاد الأوروبي.

وهناك أيضاً مزيد من القواعد الأساسية للأنظمة "ذات الأغراض العامة" التي يمكن استخدامها في مواقف مختلفة، بعضها شديد الخطورة.

ولكن سيتعين على مقدمي أنظمة الذكاء الاصطناعي للأغراض العامة القوية، بشكل خاص، إخطار المفوضية الأوروبية إذا كان النظام يتمتع بقدرات تقنية معينة.

وحال عدم تمكن مقدم الخدمة من إثبات أن نظامه لا يشكل أي خطر جدي، يمكن للمفوضية أن تصنفه على أنه "نموذج ذكاء اصطناعي للأغراض العامة يشكل مخاطر نظامية"، حيث يتم بعد ذلك تطبيق قواعد أكثر صرامة لتخفيف المخاطر.

ويتعين وضع علامة على المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي، مثل الصور أو الصوت أو النص على هذا النحو للحماية من التزييف العميق المضلل.

واقترحت المفوضية الأوروبية المسودة الأولى لقانون الذكاء الاصطناعي في أبريل (نيسان)2021.